В мире современных технологий deepfake становится все более увлекательным и творческим средством создания удивительных видеоконтентов. В этой статье мы рассмотрим один из захватывающих инструментов для улучшения реализма и эмоциональной выразительности deepfake видео — Easy-Wav2Lip. Фокусируясь на синхронизации движения губ с аудиозаписью, мы исследуем простой и эффективный подход к достижению непревзойденной точности в визуальной передаче речи и эмоций на созданных дипфейк видеоматериалах.

Синхронизация движения губ на дипфейках

Следуйте инструкции указанной ниже и повторяйте все действия последовательно:

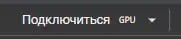

- Переходим по данной ссылке и активируем соединение, кликнув на кнопку “Подключиться” в правом верхнем углу;

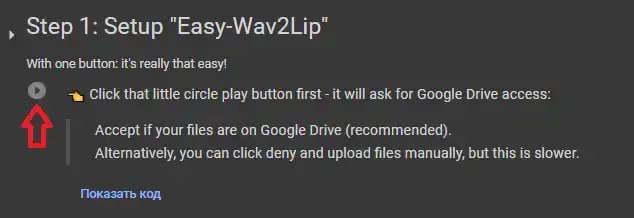

- Как только видеокарта станет доступной, приступаем к выполнению первой ячейки кода. Далее, последовательно нажимаем на кнопки: “Выполнить”, “Выполнить”, “Подключиться к Google Диску”. После этого производим авторизацию в учетной записи “Google”и предоставляем необходимые разрешения;

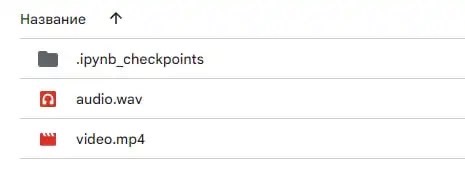

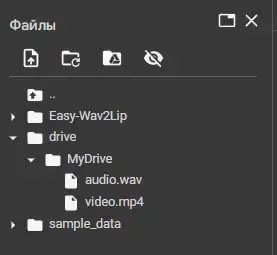

- Переходим к добавлению исходных файлов — видео должно быть в формате .mp4, а аудио — в .wav. Загружаем свои исходные файлы на “Google Диск”, который мы предварительно подключили;

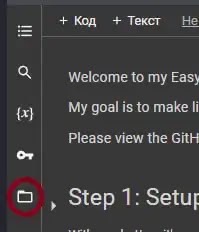

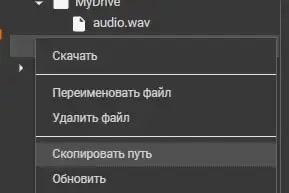

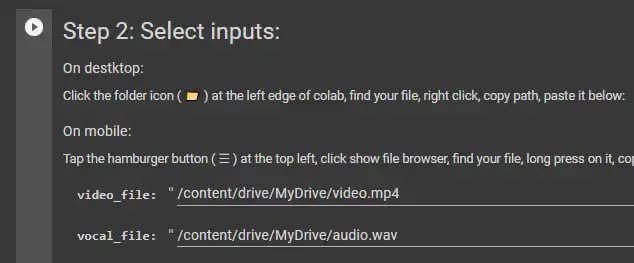

- Теперь необходимо указать путь к файлам в ячейках кода. Для этого нажимаем на значок папки и следуем пути к “MyDrive”. Затем копируем путь и вставляем его в меню “Step2: Select Inputs”;

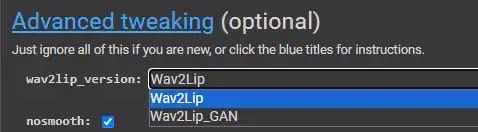

- Выбираем желаемое качество, рекомендуется выбирать “Enhanced”. Также выбираем версию нейронной сети, что зависит от индивидуальных предпочтений, рекомендуется опробовать две версии для каждого проекта;

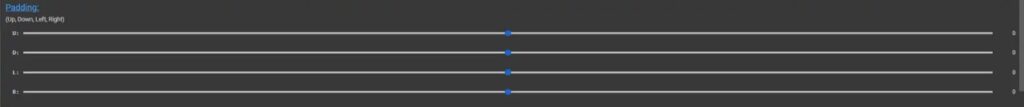

- Запускаем процесс создания deepfake. После получения результата внимательно проверяем наличие артефактов. В случае удовлетворительного результата скачиваем конечный файл. В противном случае переходим в раздел “Padding” и проводим эксперименты с настройками.

Готово! Качество создаваемого deepfake в значительной степени зависит от выбора исходного видео. Рекомендуется использовать видео, где человек смотрит прямо в камеру и не проявляет излишнюю активность. Эти факторы способствуют более устойчивому и высококачественному результату в процессе генерации.

Столкнулся с такой проблемой . Кто знает , подскажите пожалуйста как это исправить

также